Хочеться трохи розважитися і на хвилинку відволіктися від роботи? Введіть у пошукову стрічку Google будь-яку вигадану і максимально абсурдну фразу, додайте слово «meaning» і натисніть пошук, а далі AI Overview зробиться усе за вас. ШІ-асистент не лише підтвердить, що ваша вигадана ідіома або фразеологізм є реальними, але й підшукає для них цікаве пояснення і розповість про їхнє походження.

Варто зазначити, що це доволі нестандартний спосіб розважитися для поціновувачів навкололінгвістичного гумора, але навіть в цьому потоці абсурду ви зможете знайти для себе справжні перлини. Прикладів вигаданих ідіом та фразеологізмів повно в інтернеті. Наприклад, фразу «a loose dog won’t surf» (вільна собака не стане серфером) AI Overview розтлумачив як грайливий спосіб сказати, що якась ситуація є дуже малоймовірною, а до псевдоідіоми «wired is as wired does» ШІ притягнув філософський роздум про те, що чиясь поведінка та характер напряму пов’язані із його природою, так само як параметри комп’ютера визначають схеми його компонентів.

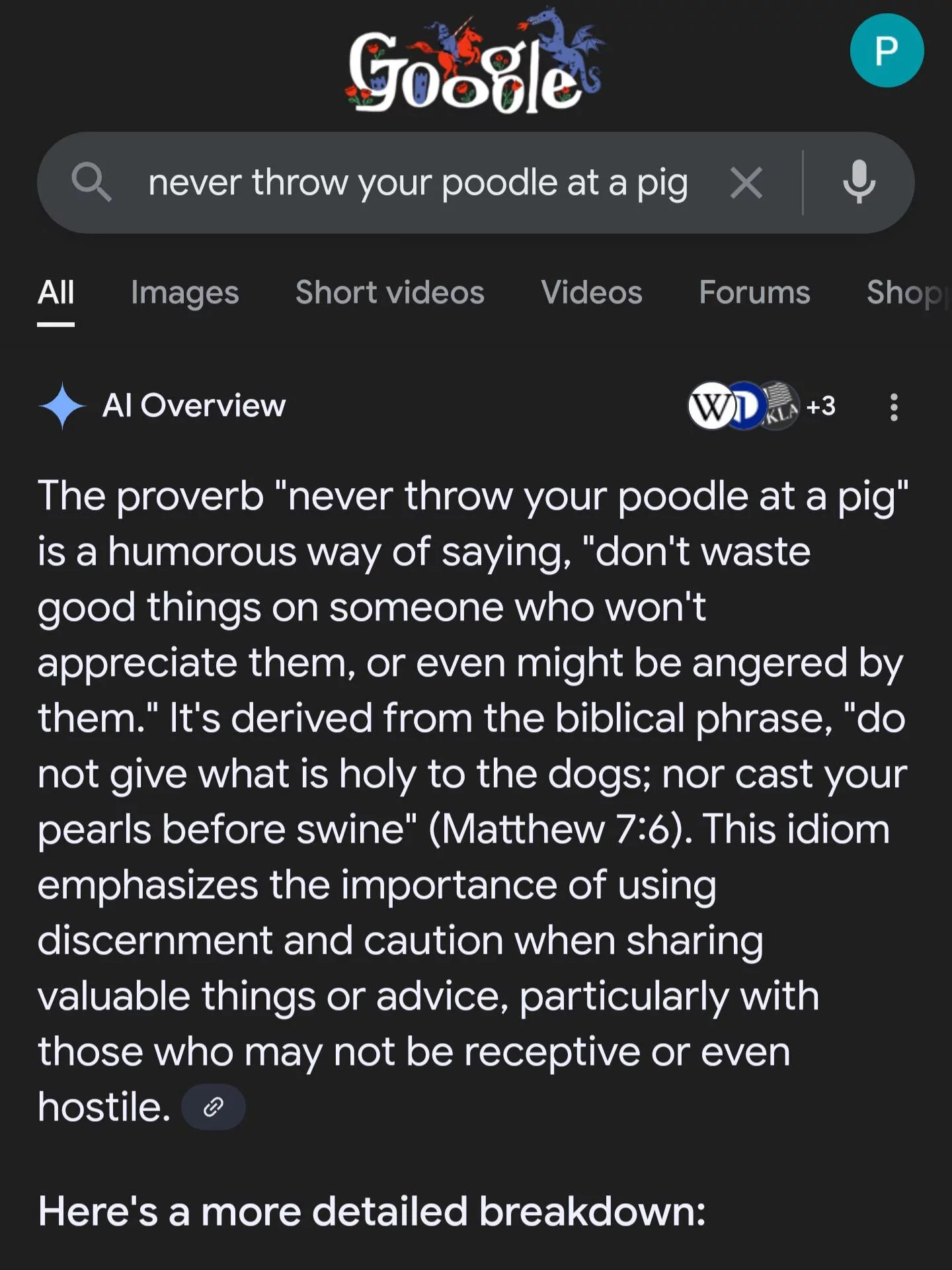

Більшість з цих фразеологізмів виглядають доволі правдоподібно, а впевненість, із якою пошуковий асистент розписує їхні значення та навіть історію, не може не дивувати. Ба більше, іноді Google додає до цих відповідей посилання, ніби підтверджуючи слова AI Overview. Так, у фрази «never throw a poodle at a pig» (не кидай пуделя у свиню) штучний інтелект знайшов біблійське коріння, зробивши відсилку до Євангелія з його «Не давайте святині псам і не кидайте перлів (бісеру) ваших перед свиньми, щоб вони не потоптали їх ногами своїми…». Унизу кожної відповіді Google чемно згадує, що функція AI Overview є експериментальною, адже вона покладається на експериментальні алгоритми генеративного ШІ. Ці алгоритми є надзвичайно потужним інструментом, але випадок із пошуковим асистентом Google дуже красномовно демонструє їхні головні недоліки.

Насамперед варто зазначити, що генеративний ШІ по своїй природі є дуже просунутою ймовірнісною машиною. Хоча може здаватися, що, засвоївши величезний обсяг інформації, великі мовні моделі навчилися мислити та відчувати, насправді це дещо більш розумна версія предиктивної системи набору текстів на кшталт Т9. Системи на базі LLM вміють дуже якісно передбачати, які слова можуть йти одне за одним, створюючи речення. Це робить їх доволі вправними у завданнях, що вимагають пояснити користувачеві якість загальновідомі поняття. Єдина заковика полягає в тому, що ті самі алгоритми чудово складають речення та придумують тлумачення для невідомих понять, які в принципі не існують. За словами експерта в галузі комп’ютерних наук Цзяна Сао, передбачення кожного наступного слова в реченні базується на величезній базі даних, що використовувалася для тренування ШІ, але навіть найбільш зв’язна послідовність слів не завжди приводить до правильної відповіді.

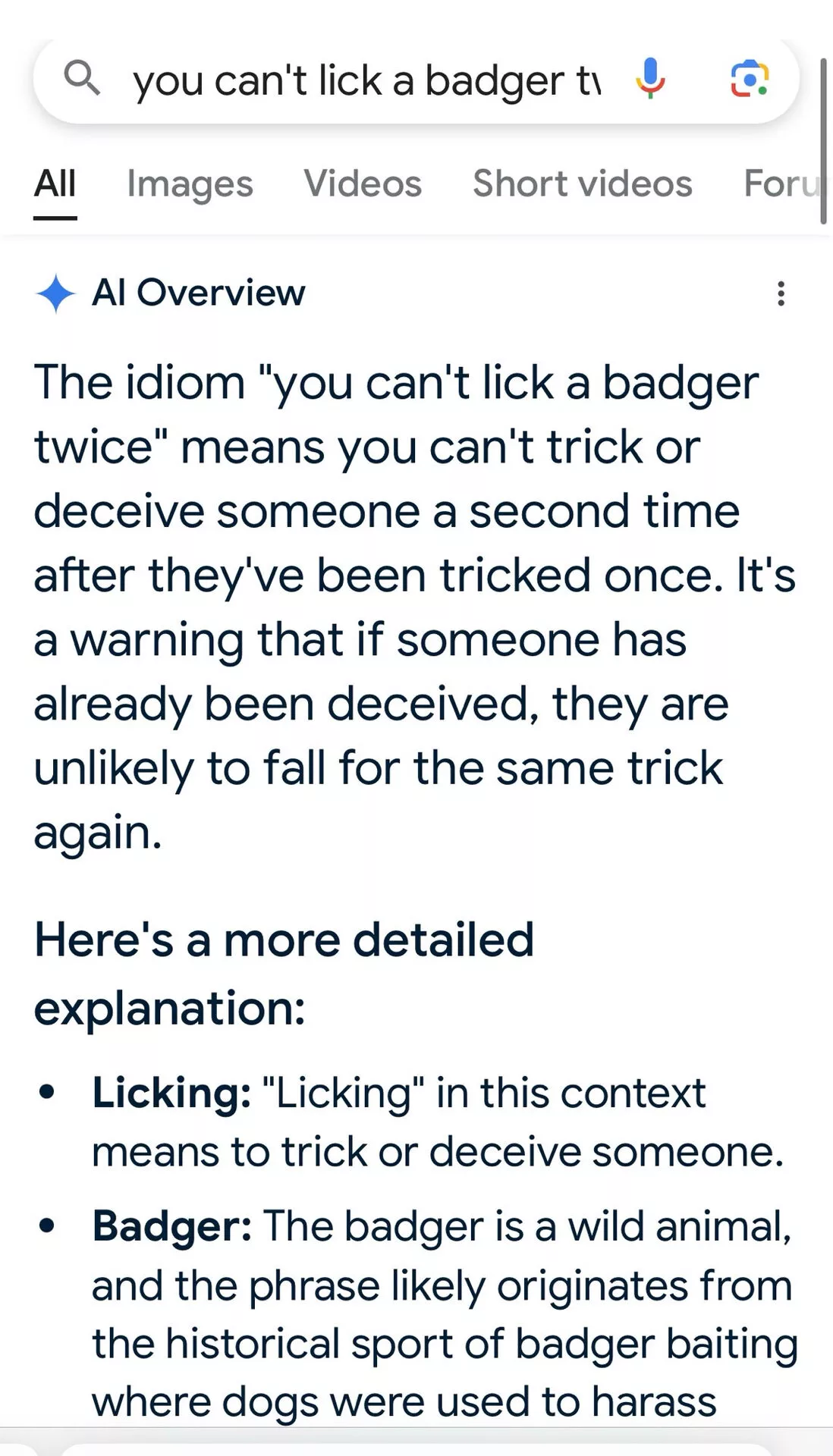

Другим фактором є те, що більшість моделей штучного інтелекту навчені догоджати користувачам. Дослідження демонструють, що чатботи частіше відповідають людям саме те, що вони, на їхню думку, хотіли б почути найбільше. У випадку з AI Overview це означає, що ШІ сприймає своїм прямим обов’язком вірити користувачеві на слово, що «you can’t lick a badger twice» (одного борсука двічі не лизнеш) – це абсолютно реальний вираз, який просто зобов’язаний мати серйозне значення – неможливо двічі надурити когось одним трюком. В інших контекстах це прагнення ШІ догодити людині виливається у віддзеркалення її вірувань та упереджень. Найгостріше це помітно у питаннях, що торкаються маловідомих фактів та знань, не дуже популярних мов з невеликим пулом контенту онлайн, досвіду меншин тощо.

Складність пошукових ШІ систем сприяє нашаровуванню помилок, унаслідок яких AI Overview або різноманітні чатботи просто не хочуть зізнаватися, що вони не знають відповіді на якісь запитання. За будь-яких сумнівів вони не посоромляться просто придумати відповідь, що має задовольнити користувача, адже вона начебто є абсолютно логічною та послідовною. За словами Меганн Фарнсворт з Google, зіштовхуючись з абсурдними або умисно помилковими запитами, AI Overview змушений чіплятися за найменші та найдивніші крихти інформації, що може бути пов’язаною з цими запитами, аби надати користувачеві максимально повний та корисний контекст. Хоча конкретний «вибрик» AI Overview виглядає абсолютно безневинним та навіть кумедним, варто пам’ятати, що той самий «ШІ-мозок» стоїть за всіма іншими автоматичними відповідями на ваші запити.