Группа учёных из Калифорнийского университета в Сан-Франциско научилась синтезировать речь на основе сигналов мозговой активности. Используя инновационный имплантат, предназначенный для лечения эпилепсии, исследователи регистрировали активность мозга и переводили нейронные волны в связные предложения.

В наши дни средства общения для людей, по какой-то причине лишённых возможности формулировать связную речь, всё ещё весьма ограничены. Зачастую подобные методы полагаются на незначительные движения глаз, потому больным требуется немало времени, чтобы донести окружающим свою мысль. В связи с этим и сами пациенты, и их опекуны испытывают трудности с пониманием друг друга, что нередко усугубляет и без того сложную ситуацию. Специалисты из Калифорнийского университета в Сан-Франциско решили обойти завесу непонимания, обратившись напрямую к мозгу.

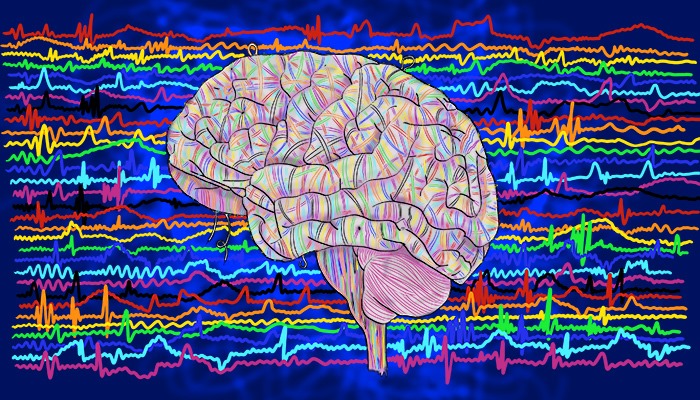

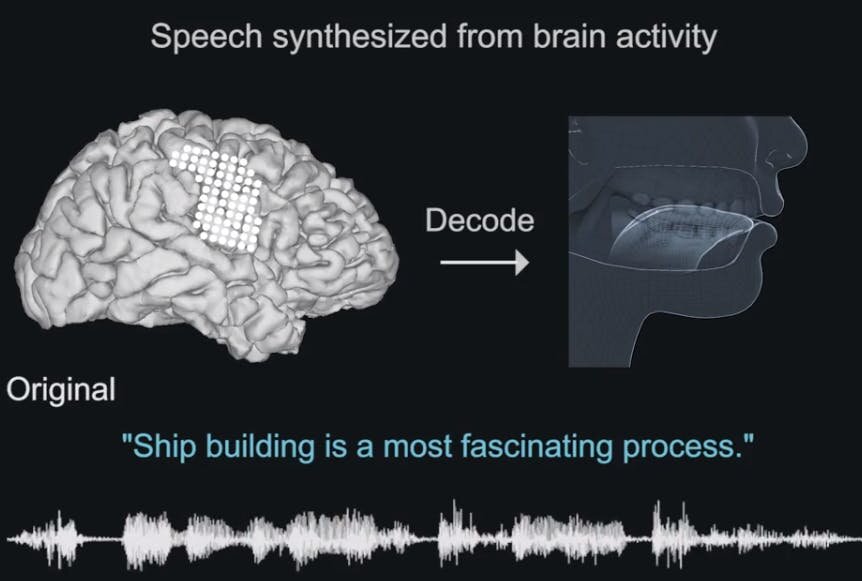

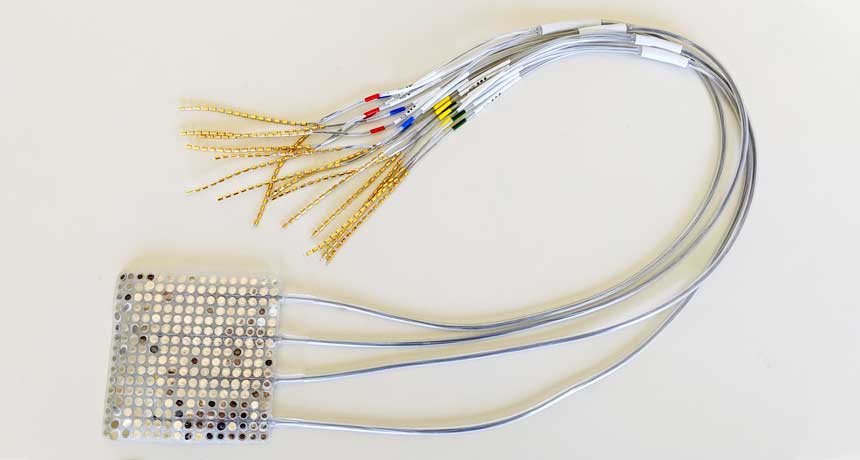

Нейролингвист Гопала Ануманчипалли и его коллеги – нейрохирург Эдвард Чанг и биоинженер Джош Шартье – исследовали речь пяти пациентов. Больным для лечения эпилепсии установили имплантаты с электродами, которые считывают нейронные сигналы. Так как испытуемые могли говорить, учёным удалось соотнести их речь – формирование мыслей, движение губ, языка и челюсти, вибрации гортани и голосовых связок – с сигналами, которые производил мозг. Это позволило исследователем создать виртуальный речевой аппарат для каждого испытуемого.

Нейролингвист Гопала Ануманчипалли и его коллеги – нейрохирург Эдвард Чанг и биоинженер Джош Шартье – исследовали речь пяти пациентов. Больным для лечения эпилепсии установили имплантаты с электродами, которые считывают нейронные сигналы. Так как испытуемые могли говорить, учёным удалось соотнести их речь – формирование мыслей, движение губ, языка и челюсти, вибрации гортани и голосовых связок – с сигналами, которые производил мозг. Это позволило исследователем создать виртуальный речевой аппарат для каждого испытуемого.

Следующим шагом была расшифровка движений виртуального голосового тракта и преобразование этих движений в звуки. Шартье рассказал, что полученные звуки получились слишком «искусственными», потому учёные попытались придать им более естественный тембр с помощью виртуальных инструментов, имитирующих человеческий голос. Затем исследователи попросили нескольких человек послушать синтезированную речь и оценить, насколько понятным было услышанное. По результатам данного теста, более 70% слов были достаточно чёткими, но отдельные звуки вызывали трудности, например, слушатели не могли различить некоторые парные согласные.

На данном этапе работ технология не готова к применению за пределами лаборатории. Для анализа и расшифровки нейронных сигналов учёные используют высокотехнологичное оборудование, недоступное широким слоям населения. Даже со специальным оборудованием этот процесс занимает достаточно много времени. Кроме того, данная методика основывается на понимании того, как связан мозг и речевой аппарат конкретного человека. В случае с отдельными заболеваниями, например, при инсульте мозгового ствола, травме голосовых связок или болезни Лу Герига, артикуляционная моторика у больных искажена либо и вовсе отсутствует. Это значит, что существующий алгоритм не сможет преобразовать волны мозга в связную речь, не имея данных об особенностях движения речевого аппарата человека. К сожалению, этот факт является самым большим препятствием на пути дальнейшего развития технологии, однако калифорнийские учёные не унывают.

В ходе второй стадии исследования – преобразования движений виртуального речевого аппарата в связную речь – учёные заметили, что артикуляции голосового тракта были достаточно однообразными для всех испытуемых. Схожие черты между движениями речевых аппаратов разных людей предполагают возможность создания универсального виртуального голосового тракта. Самый сложный этап предстоящей работы заключается в составлении универсальной карты сигналов головного мозга, с помощью которой можно имитировать движение речевого аппарата.